为什么选择 Dify?

在 2026 年,AI 应用开发已经进入「Agentic Workflow」时代。传统的编码方式需要开发者手动处理 LLM 调用、上下文管理、工具集成等复杂逻辑,而 Dify 作为全球领先的可视化 AI 工作流构建平台,提供了全新的开发范式。

Dify 的核心优势:

- 零代码编排:拖拽式界面构建复杂 AI 工作流,无需编写胶水代码

- 内置 RAG 引擎:一键上传文档,自动完成分块、向量化和检索

- 多模型支持:无缝切换 OpenAI、Claude、本地 Ollama 等 50+ 大模型

- MCP 原生集成:可将任意工作流发布为标准 MCP 服务器

- 生产级就绪:内置日志、监控、版本管理和 API 发布

💡 Dify 已服务全球 100 万 + 开发者,企业用户包括微软、谷歌等科技巨头,是构建生产级 AI 应用的首选平台。

准备工作:环境与工具

开始之前,确保你具备以下环境和工具:

实战步骤

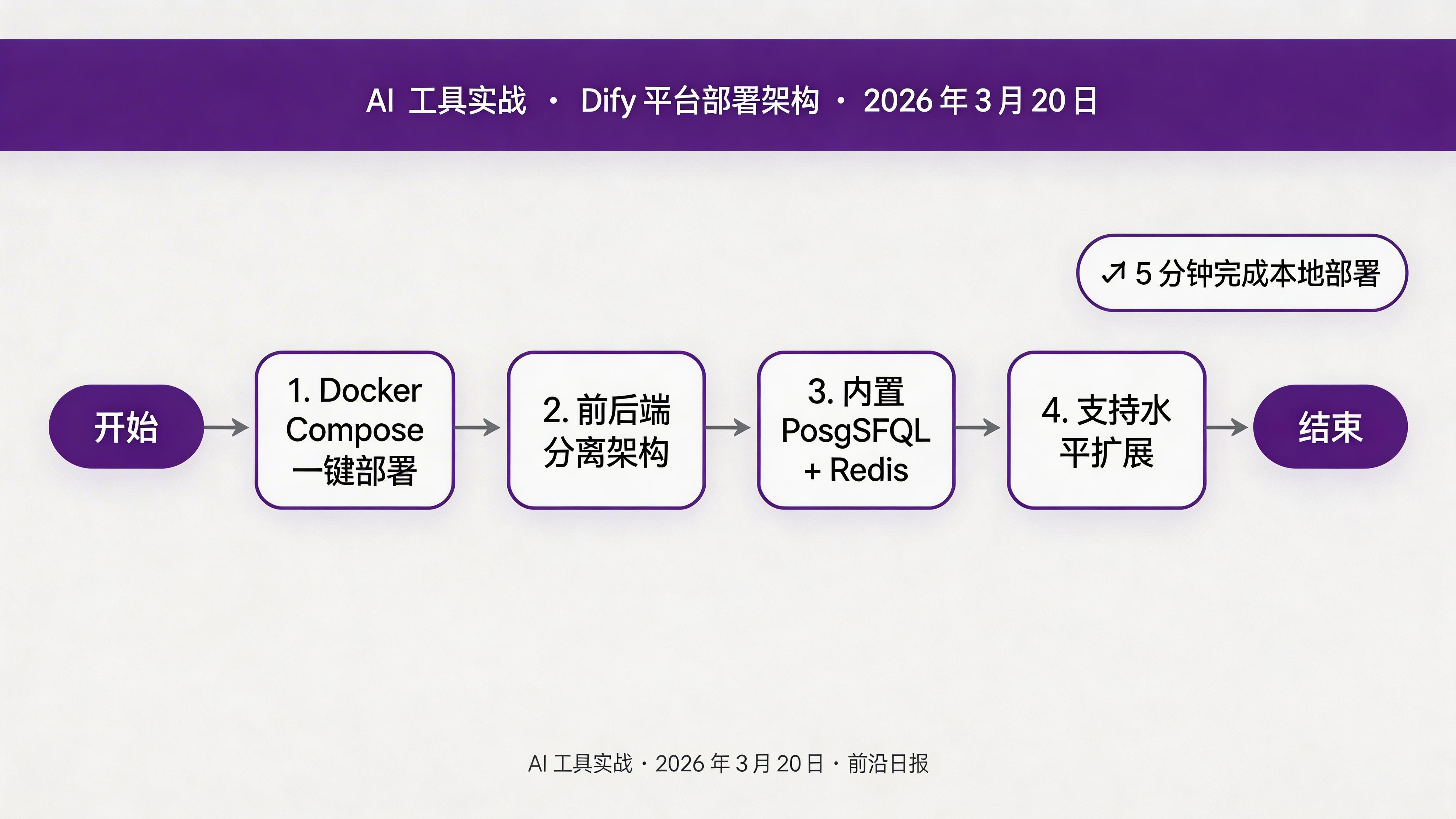

部署 Dify 平台

Dify 支持云端版和社区版两种部署方式。推荐使用云端版快速开始,或使用 Docker 本地部署获得完全控制。

# 克隆 Dify 仓库

git clone https://github.com/langgenius/dify.git

cd dify/docker

# 复制配置文件

cp .env.example .env

# 启动服务(首次启动约 5 分钟)

docker compose up -d

# 访问 http://localhost:3000 完成初始化

部署完成后,首次访问会进入初始化向导,设置管理员账号和默认工作区。

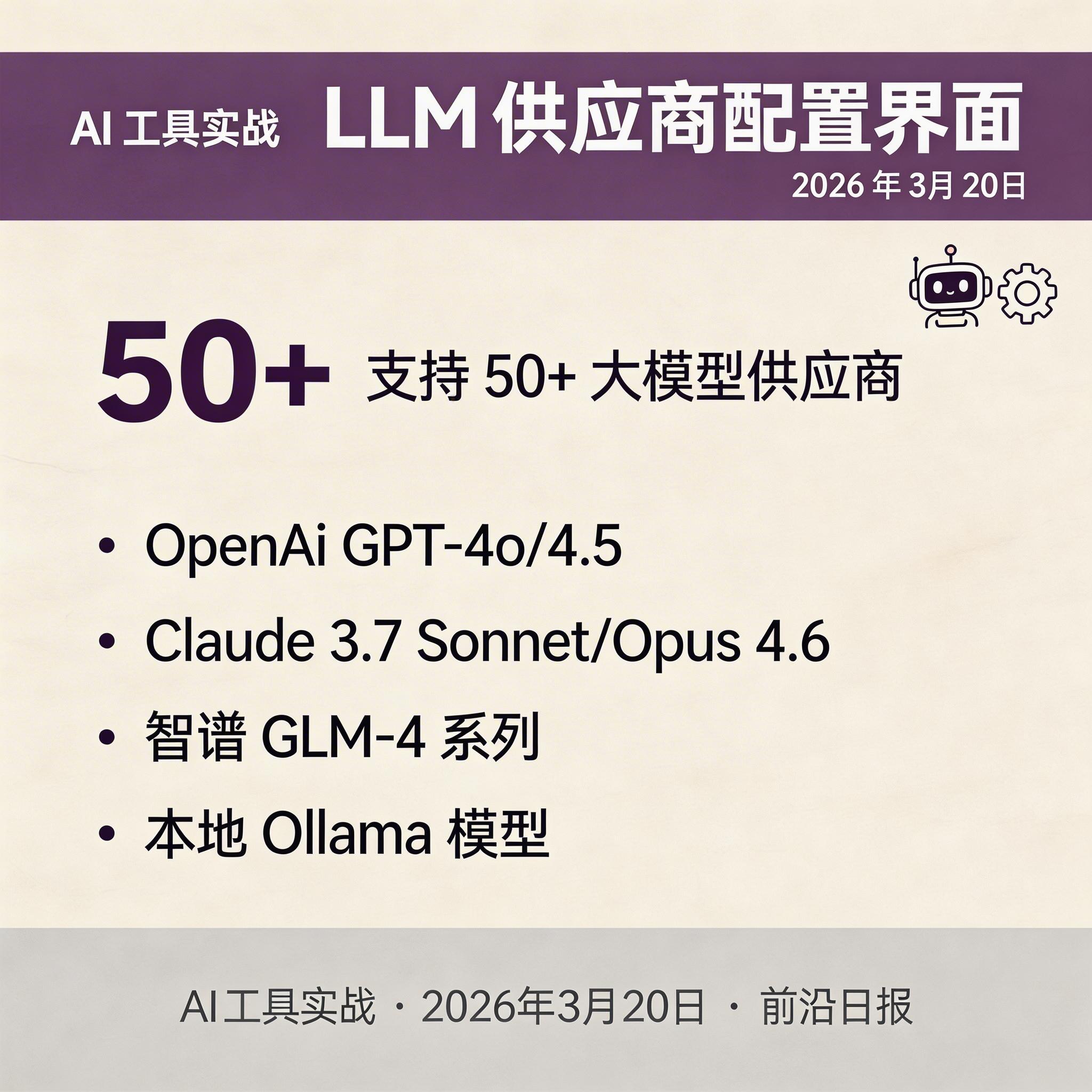

配置 LLM 供应商

进入「设置」→「模型供应商」,添加你的大模型 API 凭证。Dify 支持以下主流供应商:

- OpenAI:GPT-4o、GPT-4.5、o1 系列

- Anthropic:Claude 3.5/3.7 Sonnet、Opus 4.6

- 智谱 AI:GLM-4、GLM-4V 多模态

- Ollama:本地部署的 Llama 3、Qwen2.5 等开源模型

# 本地 Ollama 配置示例

OLLAMA_HOST=127.0.0.1:11434

OLLAMA_MODEL=llama3.1:8b

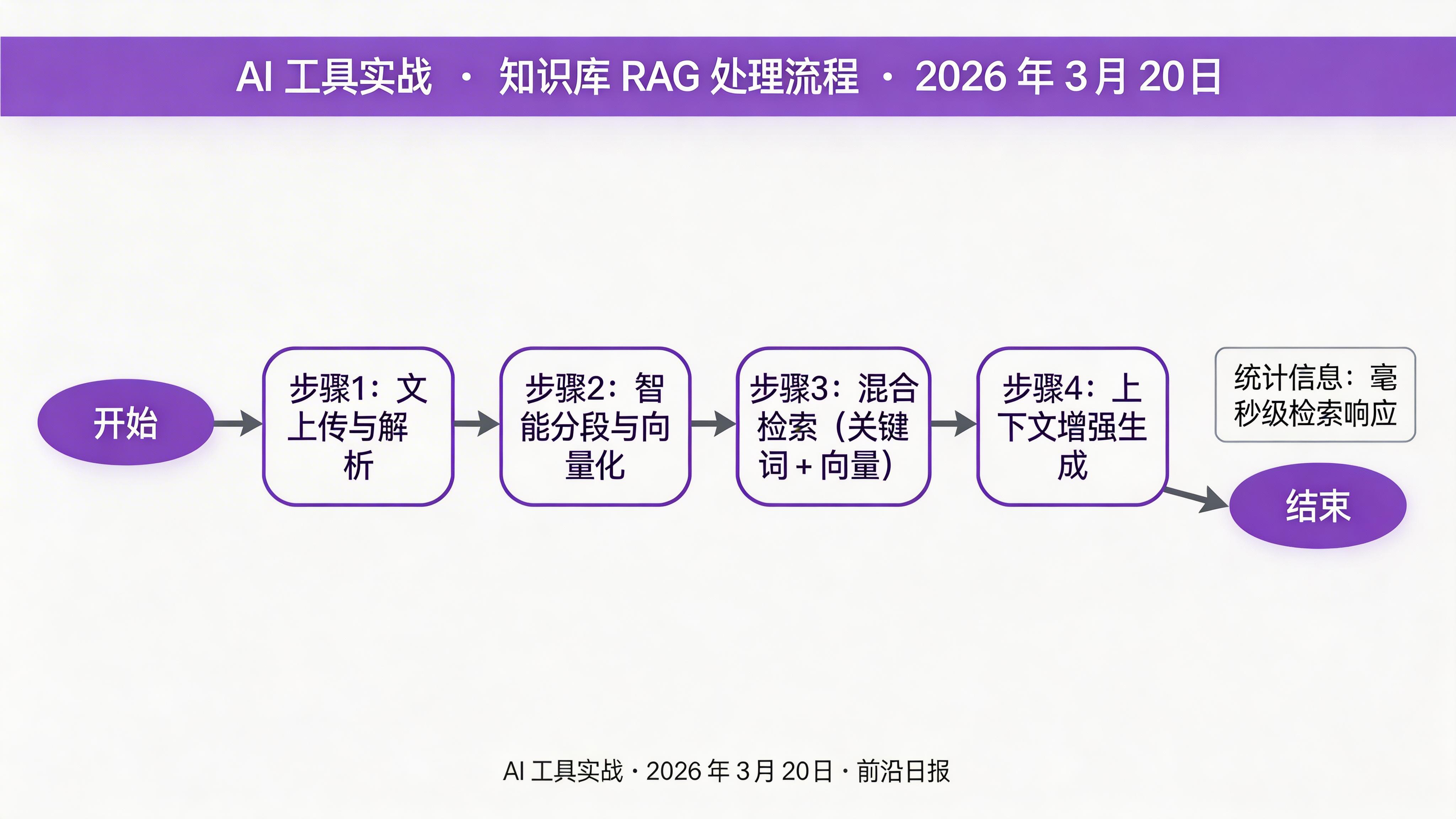

构建知识库问答机器人(RAG 实战)

这是 Dify 最经典的应用场景:上传企业文档,构建智能问答机器人。

Step 3.1 - 创建知识库

- 进入「知识库」→「创建知识库」

- 上传 PDF/Word/Markdown 文档(支持批量上传)

- 选择分段方式:自动分段 或 自定义规则

- 选择向量化模型(推荐 text-embedding-3-large)

# 自动分段配置示例

分段长度:500 tokens

重叠长度:100 tokens

向量化:text-embedding-3-large

Step 3.2 - 创建应用

- 进入「工作室」→「创建应用」→「对话型助手」

- 在「上下文」中关联已创建的知识库

- 配置系统提示词:「你是一个专业的客服助手,请基于知识库内容回答用户问题」

- 点击「运行」测试效果

⚠️ 注意:知识库分段质量直接影响回答准确性。建议上传前清理文档格式,确保段落结构清晰。

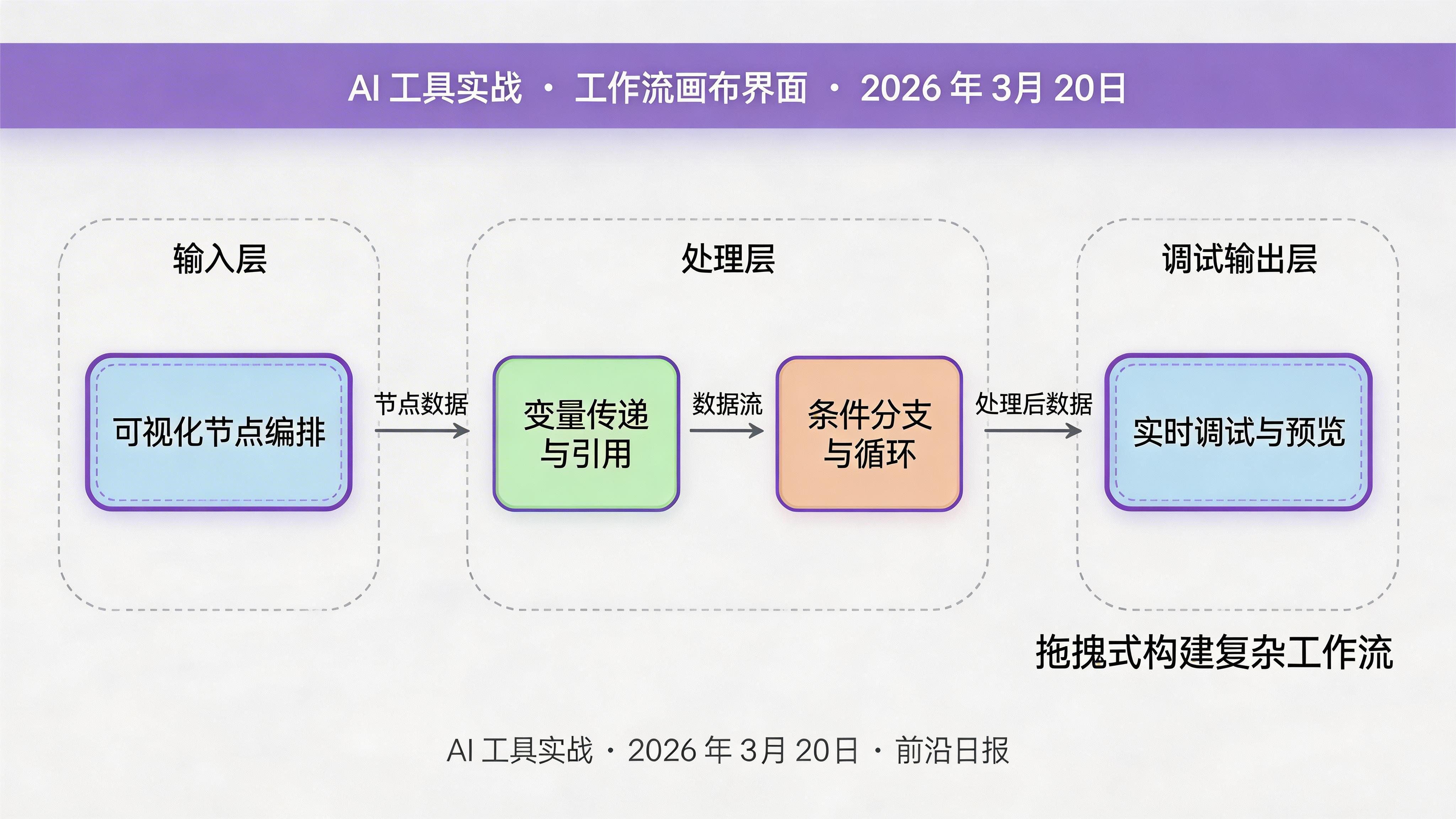

构建多工具 Agent(工作流编排)

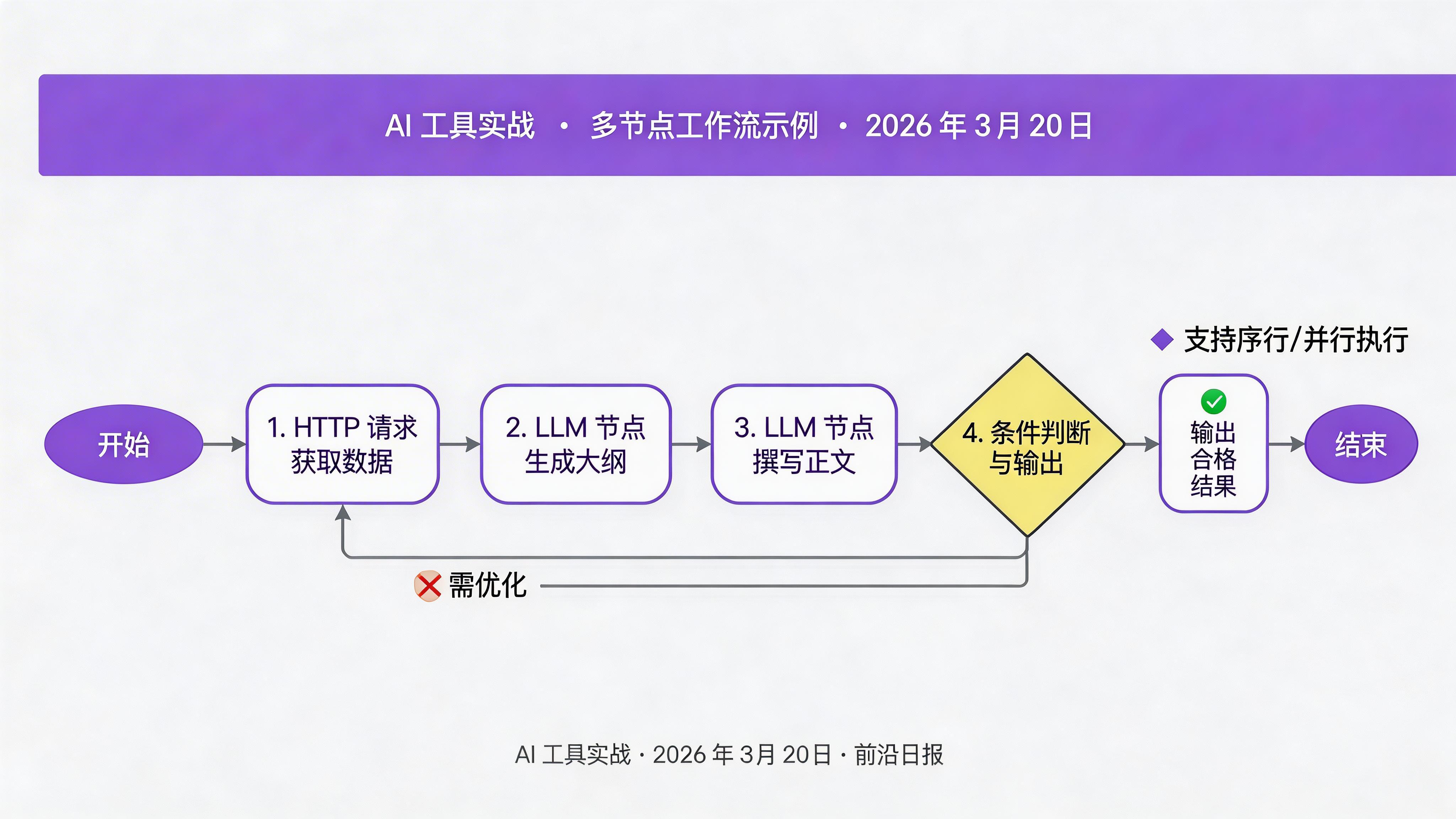

Dify 的工作流(Workflow)功能允许你编排复杂的多步骤任务。我们构建一个「内容创作 Agent」,自动完成「选题调研 → 大纲生成 → 正文撰写」全流程。

Step 4.1 - 创建工作流

- 进入「工作室」→「创建应用」→「工作流」

- 添加「开始」节点,定义输入变量:topic(选题)

Step 4.2 - 编排节点

# 节点 1:联网搜索调研

节点类型:HTTP 请求

URL:https://api.example.com/search

参数:query={{topic}} 2026 最新

# 节点 2:大纲生成

节点类型:LLM

模型:Claude 3.7 Sonnet

提示词:基于搜索结果,生成文章大纲

# 节点 3:正文撰写

节点类型:LLM

模型:GPT-4o

提示词:根据大纲撰写完整文章Step 4.3 - 调试与发布

- 点击「运行」测试整个工作流

- 查看每个节点的输入输出

- 发布为 API 或嵌入到网站

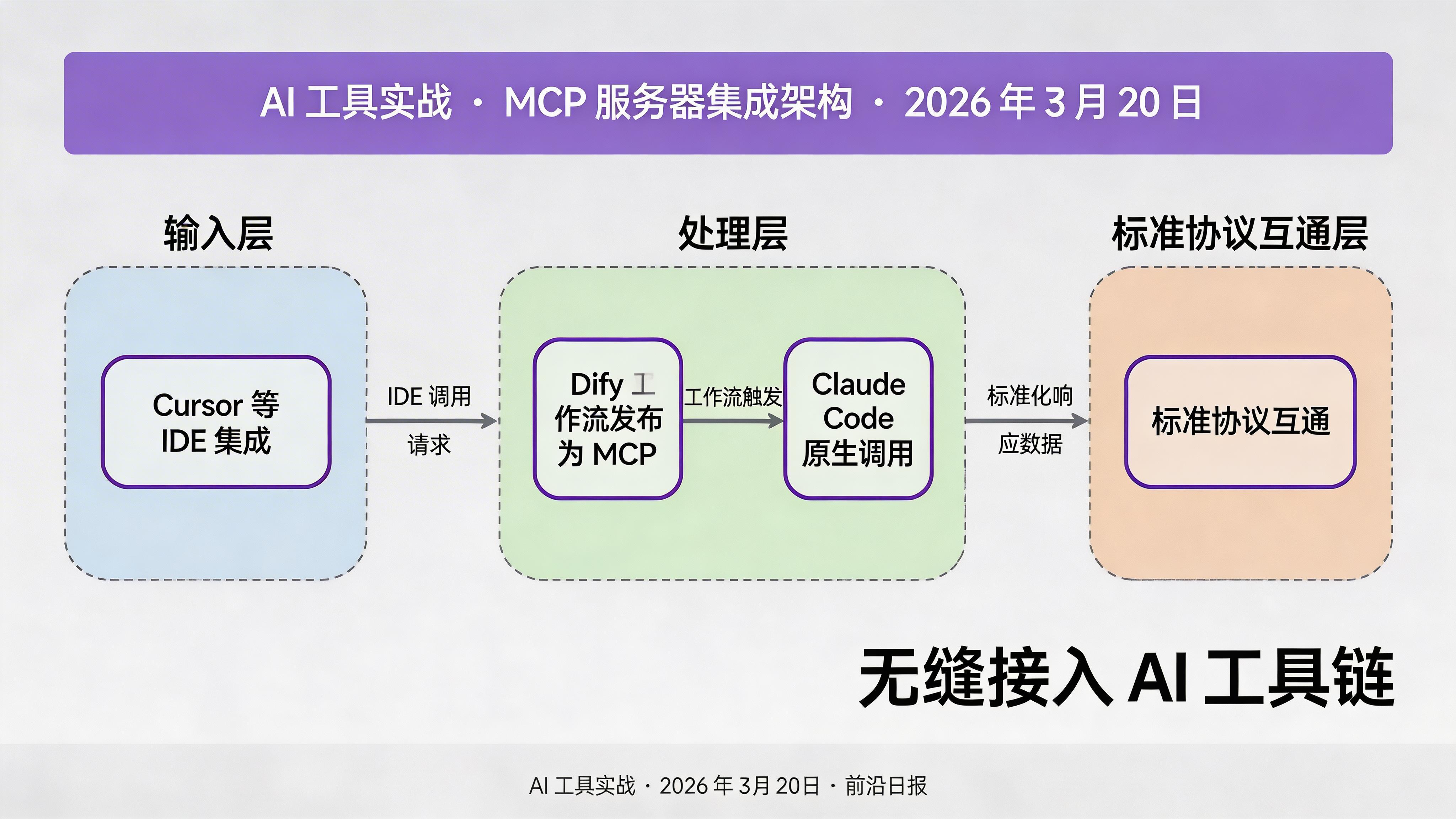

发布为 MCP 服务器(进阶)

Dify 支持将任意工作流发布为标准 MCP(Model Context Protocol)服务器,使 Claude Code、Cursor 等工具可以直接调用你的 AI 能力。

# 在工作流设置中开启 MCP 发布

发布设置:

- 启用 MCP 服务器:是

- 访问凭证:Bearer Token

- 端点:https://api.dify.ai/v1/mcp/{workflow_id}在 Claude Code 中配置:

# ~/.claude/settings.json

{

"mcpServers": {

"dify-workflow": {

"url": "https://api.dify.ai/v1/mcp/xxx",

"headers": {

"Authorization": "Bearer YOUR_API_KEY"

}

}

}

}

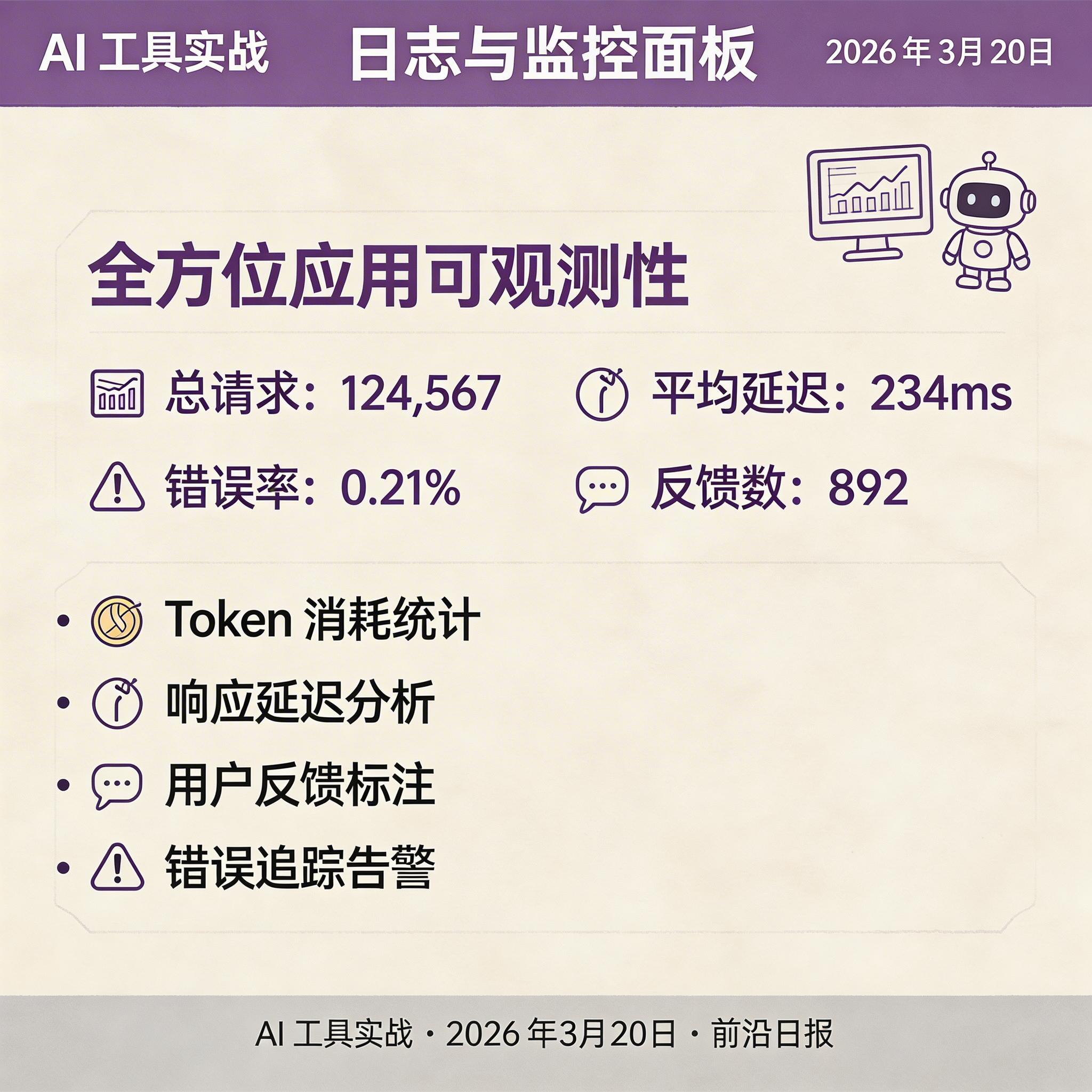

监控与优化

进入「日志与标注」查看所有请求日志,包含:

- Token 消耗统计

- 响应延迟分析

- 用户反馈标注

- 失败请求追踪

基于日志数据,可以针对性优化提示词、调整模型参数或切换供应商。

常见问题(FAQ)

总结

- Dify 提供零代码的可视化 AI 应用开发体验

- 内置 RAG 引擎让知识库问答机器人搭建变得简单

- 工作流编排支持复杂多步骤任务的自动化

- MCP 发布能力让 AI 应用可以无缝集成到现有工具链

- 生产级监控和日志帮助持续优化应用性能